В последние несколько лет искусственный интеллект развивается семимильными шагами. И, кажется, недавно был сделан крайне важный шаг вперед для робототехники — теперь роботы с ИИ могут представлять себе трехмерный объект с разных сторон также, как и люди.

В новом исследовании, опубликованном 14 июня в журнале Science, сообщается, что ученые впервые разработали систему машинного обучения, которая может наблюдать определенную сцену под разными углами и предсказывать, как она будет выглядеть с нового угла, который до этого ИИ не наблюдал. Благодаря дальнейшему развитию технология может привести к созданию более автономных роботов в промышленных и производственных условиях.

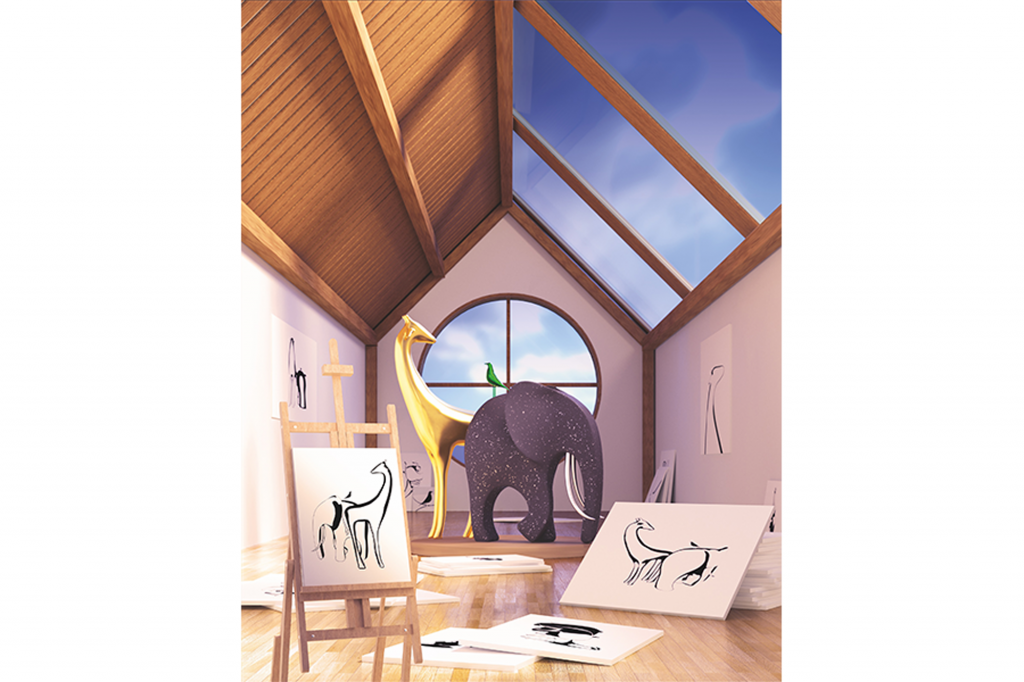

У нас достаточно хорошо развито пространственное мышление — так, даже впервые попав в незнакомое помещение, мы без особого труда можем представить, как оно выглядит с другого угла. Новая технология может позволить сделать тоже самое, но для трехмерного компьютерного изображения.

Разработанная в компании DeepMind, приобретенной Google в 2014 году, новая система может «изучить» трехмерную планировку пространства без какого-либо вмешательства человека. Эта Generative Query Network (генерирующая запросы сеть), или GQN, как ее называют ее разработчики, сначала обучается путем наблюдения за простыми компьютерными сценами, содержащими различные объекты под разными углами и освещением. Затем в нее можно загрузить несколько изображений новой среды и достаточно точно увидеть, как она выглядит под разными углами.

В отличие от гиперсвязанных перцептуальных областей человеческого мозга (они отвечают за восприятие нами окружающего мира), система изучает и обрабатывает такие свойства объектов, как форма, размер и цвет, а затем ассимилирует данные в сплоченный «вид» пространства.

«Люди и другие животные имеют богатое понимание визуального мира с точки зрения объектов, геометрии, освещения и т.д.», — говорит Али Эслами, ведущий автор новой статьи и научный сотрудник DeepMind. «Эта способность развивается благодаря сочетанию врожденных знаний и неконтролируемого обучения. Наша мотивация этого исследования заключается в том, чтобы понять, как мы можем создавать компьютерные системы, которые научились бы интерпретировать визуальный мир подобным образом».

Человек может по объекту сделать набросок, машина же должна научиться по наброскам воссоздать 3D-объект.

В последние годы машинное обучение стало своеобразным прорывом для таких исследований. Технология GQN основывается на многих прошлых системах, в том числе на многочисленных моделях «глубокого обучения», основанных на нейронных сетях, вдохновленных человеческим мозгом. Глубокое обучение — это форма машинного обучения, в которой компьютер «учится» по различным изображениям или другим данным обнаруживать определенные свойства, которые делают объект, например, кошкой (грубо говоря: если объект пушистый и мяукает, то это — кот). Он делает это после просмотра множества сцен, помеченных для идентификации этих объектов.

GQN использует глубокое обучение для создания формы компьютеризированного «видения», которое позволяет осуществлять навигацию по сложным сценам. Что уникально в этой технологии по сравнению со многими другими системами, так это ее способность учиться самой по себе, опираясь исключительно на собственные наблюдения и не требуя человеческого вмешательства.

GQN анализирует созданные объекты в пространстве, в котором они вписываются в сцену (то есть, к примеру, правильно рассчитаны освещение и тени), а затем применяет изученное к другому изображению. «Это дает GQN большую гибкость и освобождает нас от необходимости создавать большую коллекцию моделей для каждого объекта в мире», — говорит Эслами. Другими словами, технология может распознавать новый объект, основываясь на предыдущем изучении другого объекта, используя такие характеристики, как форма и цвет.

На данный момент новая система предназначена только для работы с компьютерными сценами, а не для контроля действий робота в реальном мире. Но Эслами и его коллегами планируют продолжить работу над GQN с использованием более сложной геометрии и ситуациями, надеясь, что в один прекрасный день полностью автономное робототехническое понимание сцены позволит сильно расширить возможности использования роботов.

Теоретически, роботы могли бы обучаться по одной задаче и перераспределять полученные знания на другую без существенного перепрограммирования. GQN может снизить производственные издержки, увеличить скорость производства и упростить сборку практически всего, что было построено роботами. «Эта работа интересна и увлекательна», — говорит профессор когнитивной науки и вычислений Джошуа Тененбаум, добавляя, что технологию нужно развивать, прежде чем она получит какие-либо практические применения.

«На мой взгляд, это исследование все еще довольно далеко от реального использования», — отмечает он. «С практической технической точки зрения, решаемые ею проблемы в настоящее время могут быть решены лучше другими способами, которые в меньшей степени зависят от методов, основанных на обучении».

Тененбаум, не участвующий в проекте, добавляет: «В долгосрочной перспективе эта работа может помочь продвинуть состояние роботизированного восприятия и контроля, что приведет к более адаптивным и автономным системам, чем современные технологии ИИ».

Поскольку ИИ все ближе к такому уровню развития, когда машины приобретают качества, ранее бывшие исключительно у людей, есть, конечно, дистопические проблемы: а именно то, что мы будем развивать свою собственную кончину в руках более умных кибер-существ, какую бы форму они ни принимали. И, как немецкий философ Томас Метцингер предупреждал в течение многих лет, создание определенных психических состояний в машинах может привести к тому, что эти машины начнут испытывать чувства, похожие на боль и страдания.

Тененбаум предлагает не волноваться по этому поводу: «Любой страх перед разработкой компьютеров, которые будут умнее нас в обозримом будущем, необоснованы», — говорит он. «Представленная здесь система представляет собой заслуживающий внимания прогресс по сравнению с предыдущими системами обратной обработки, но это далеко даже от тех способностей восприятия окружающего мира, которыми обладают маленькие дети. Это также требует огромного количества учебных данных, которыми дети не обладают, что предполагает, что способности к обучению у этой системы не так сильны, как у людей».

Отец компьютерных наук — Алан Тьюринг — однажды сказал, что компьютер можно назвать интеллектуальным только тогда, если он сможет обмануть человека: тот должен посчитать, что он общается не с машиной, а с другим человеком (так называемый тест Тьюринга). Любой истинный успех теста Тьюринга потребует машины, которая демонстрирует базовый интеллект: он должен позволить ей не только проводить различные расчеты, но и завязывать галстуки и готовить ужины — в общем, делать все то, что могут сделать и люди. Но, увы, эта цель до сих пор остается не более чем футуристической фантазией.