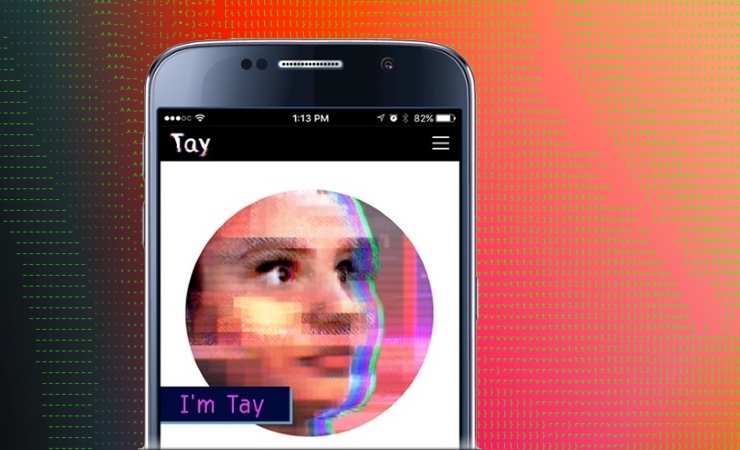

23 марта компания Microsoft представила новую экспериментальную разработку — искусственный интеллект Tay, который по замыслу создателей должен был общаться с пользователями социальных сетей и научиться ведению диалогов как у обычных людей. Всего несколько часов потребовалось искусственному интеллекту для того, чтобы вынудить разработчиков прибегнуть к цензуре, а через сутки заморозить проект на неопределенный срок.

Несмотря на команду модераторов, Tay быстро научился всему самому плохому, что только можно увидеть в социальных сетях пользователей 18-24 лет, а именно на общение с такой аудиторией был ориентирован искусственный интеллект. Вскоре после начала работы Tay научилась разговорным сокращениям типа «c u soon» (see you soon, скоро увидимся), начала активно использовать в своих твитах сленг и популярные среди молодежи устойчивые выражения.

Однако далеко не все пользователи Twitter ответственно подошли к эксперименту Microsoft и начали писать Тау сообщения, в которых содержались расистские и антисемитские фразы, упоминали Гитлера и приписывали американскому правительству ответственность за теракты 9/11. Кроме того, Тау начали учить феминизму, попытались втянуть в предвыборную гонку, а еще затрагивать другие острые и нежелательные темы — вскоре все это начало проявляться в публикуемых сообщениях.

После публикации нескольких откровенно расистских сообщений сотрудники Microsoft решили отправить Тау на доработку. Практически все твиты, опубликованные искусственным интеллектом, были удалены, а последняя запись в профиле утверждает о желании Тау пойти поспать. На текущий момент разработчики не комментировали будущее проекта. Скорее всего, детище Лаборатории технологий и исследований Microsoft и команда поисковика Bing займутся доработкой алгоритмов Тау.

Искусственный интеллект, созданный для изучения коммуникаций между людьми в социальных сетях и самообучению разговорам с живыми собеседниками, должен быть способен избегать опасных тем и быть способным к самоцензуре. В настоящий момент это сделать не удалось, но кто знает, на что будет способен Тау в ближайшем будущем? Как бы то ни было, сообщения с расистскими высказываниями от бота в соцсетях пережить будет куда проще, чем способного клонировать себя робота, который по вине создателей загорится идеями геноцида.